Na indústria de tecnologia, dificilmente você consegue conversar sem que alguém mencione inferência, inteligência artificial (IA) e aprendizado de máquina (ML). No entanto, é importante notar que embora todos estes termos estejam interligados, eles também diferem significativamente.

Neste artigo, explicaremos as diferenças fundamentais e destacaremos a importância do uso da tecnologia de IA de borda baseada-no processamento de tensor, especialmente em sistemas de borda e integrados. Em comparação com soluções baseadas em unidades de processamento gráfico (GPUs), as unidades de processamento tensor (TPUs) oferecem desempenho mais eficiente e-com melhor custo-benefício. Também forneceremos alguns exemplos de casos de uso que ilustram onde você poderá encontrar soluções de IA de ponta no futuro.

Fundamentos de ML e inferência

ML refere-se à metodologia de treinamento de modelos usando dados representativos para permitir que as máquinas aprendam como executar tarefas. Este processo pode ser altamente intensivo em termos computacionais, gerando trilhões de operações por novo ponto de dados de treinamento. A natureza iterativa do processo de treinamento, combinada com os enormes conjuntos de dados de treinamento necessários para alcançar alta precisão, impulsiona a demanda por processamento de ponto flutuante-de desempenho extremamente alto-. O treinamento de ML é melhor implementado como infraestrutura de data center, onde altos custos operacionais e de capital podem ser justificados pela amortização deles em vários clientes.

A inferência envolve o uso de modelos treinados para gerar possíveis correspondências para novos dados relevantes aos dados representativos sobre os quais o modelo foi treinado. A inferência visa fornecer respostas rápidas em milissegundos. Exemplos de inferência incluem reconhecimento de fala, tradução-de idiomas em tempo real, visão mecânica e decisões de otimização de inserção de publicidade. Embora a inferência exija apenas uma fração do poder de processamento necessário para o treinamento, ela ainda excede em muito o que os sistemas tradicionais-baseados em unidades de processamento central (CPU) podem oferecer, especialmente para aplicativos de visão computacional. É por isso que tantas empresas estão recorrendo a soluções de aceleração-baseadas em tensor-seja como IP em SoCs ou como em-aceleradores de sistema-para atingir os tempos de resposta inferiores a{10}}segundos necessários na borda. A realidade é que gastar um minuto ou alguns segundos processando imagens em um sistema de visão não é muito útil. Os sistemas de visão industrial estão buscando velocidades de processamento de nível{13}}de milissegundos.

Separando Treinamento e Inferência

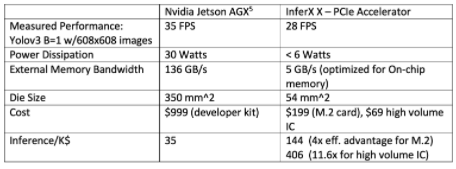

A implantação do mesmo hardware usado no treinamento para lidar com cargas de trabalho de inferência pode resultar no-provisionamento excessivo de máquinas de inferência com aceleradores e hardware de CPU. As soluções de GPU desenvolvidas para ML na última década não são necessariamente a escolha ideal para implantação em grande-escala de tecnologias de inferência de ML. O diagrama abaixo ilustra perfeitamente a comparação entre aceleradores TPU e aceleradores GPU. Isso mostra claramente que os aceleradores TPU oferecem menor consumo de energia, custos reduzidos e maior eficiência em comparação com soluções AGX baseadas em GPU, ao mesmo tempo que fornecem níveis de desempenho atraentes para aplicativos de inferência.

Outra consideração crítica ao abordar soluções de treinamento e inferência de ML é o ambiente de software. Hoje, diversas bibliotecas populares estão em uso, como CUDA para GPUs NVIDIA, estruturas de ML como TensorFlow e PyTorch, bibliotecas de modelos-de plataforma cruzada otimizadas como Keras e muito mais. Esses kits de ferramentas são essenciais para desenvolver e treinar modelos de ML, mas os aplicativos de inferência exigem um conjunto diferente e menor de ferramentas de software.

Os kits de ferramentas de inferência concentram-se na execução de modelos em plataformas de destino. Eles suportam a portabilidade de modelos treinados para plataformas, o que pode envolver algumas transformações de operadores, quantização e serviços de integração de host. No entanto, isto representa um conjunto relativamente simples de funcionalidades em comparação com aquelas necessárias para o desenvolvimento e treinamento de modelos.

As ferramentas de inferência se beneficiam ao começar com uma representação padronizada do modelo. O Open Neural Network Exchange (ONNX) é o formato padrão para representar modelos de ML. Como o nome indica, é um padrão aberto gerenciado como um projeto da Linux Foundation. Tecnologias como ONNX permitem a dissociação de sistemas de treinamento e inferência, garantindo aos desenvolvedores a liberdade de escolher diferentes plataformas otimizadas para cada um.

Exemplo de aplicações visuais

À medida que as tecnologias de ML e de processador de inferência continuam a avançar e evoluir, os aplicativos proliferam. Abaixo estão apenas alguns lugares onde você poderá encontrar essa tecnologia no futuro.

Servidores de borda em empresas como fábricas, hospitais, lojas de varejo e instituições financeiras. Por exemplo, em ambientes industriais, a IA pode ajudar na gestão de inventário, na detecção de defeitos e até na manutenção preditiva antes que surjam problemas. No varejo, permite recursos como estimativa de pose, usando visão computacional para detectar e analisar a postura humana. Os dados dessa análise ajudam os varejistas-e{4}}comerciais a entender melhor o comportamento humano e o tráfego de pedestres em suas lojas, permitindo que otimizem o layout das lojas para maximizar as vendas e a satisfação do cliente.

Imagens de alta-precisão/alta{1}}qualidade para aplicações que incluem robótica, automação/inspeção industrial, imagens médicas, imagens científicas, câmeras de vigilância e reconhecimento de objetos e fotônica. Por exemplo, métodos de aprendizado de máquina demonstraram a capacidade de detectar câncer por meio do processamento de raios X{3}}digitais. Esse processo envolve o desenvolvimento de um modelo de ML projetado para processar imagens de raios X, normalmente usando algoritmos de segmentação semântica treinados para identificar lesões cancerígenas. Durante o treinamento, imagens de câncer identificadas por radiologistas são utilizadas para ensinar à rede o que não é câncer, o que é câncer e como aparecem os diferentes tipos de câncer. Quanto mais um modelo de ML é treinado, melhor ele se torna para maximizar diagnósticos corretos e minimizar diagnósticos incorretos. Isto significa que a aprendizagem automática depende não apenas da concepção de modelos inteligentes, mas também de grandes quantidades (dezenas de milhares a milhões) de exemplos de dados cuidadosamente seleccionados onde o cancro foi habilmente identificado.

Carrinhos de compras inteligentes-Várias empresas estão desenvolvendo e implantando sistemas de compras inteligentes que reconhecem os produtos não pelos códigos de barras UPC, mas pela aparência visual da própria embalagem. Esse recurso permite que os compradores simplesmente coloquem os itens no carrinho ou no sistema de checkout sem a necessidade de localizar o código UPC e digitalizá-lo com um scanner a laser UPC. Essa tecnologia torna o processo de compra mais preciso, rápido e conveniente.

Tomando a decisão certa

As empresas devem avaliar todas as soluções disponíveis atualmente e selecionar a ideal com base no seu caso de uso específico. Eles também não podem simplesmente presumir que todas as soluções de IA são melhor implementadas em dispositivos GPU, já que as soluções baseadas em TPU-oferecem maior eficiência de processamento e menor utilização de silício, reduzindo assim o consumo de energia e os custos.